생각의 사슬: 추론 LLM 핵심 원리

추론 LLM 개발 비용으로 세상을 놀라게 한 딥시크의 발표가 있었습니다.

연산의 크기를 효과적으로 줄이고 계산과정을 최적화하여 생성형 AI의 개발과 운용에 반드시 필요한 GPU의 개수를 줄일 수 있다는 주장이 등장하였습니다.

이로 인하여 현재 빅테크 주도로 진행되고 있는 인공지능의 인프라 관련 투자가 많은 논란이 되고 있어 기본 LLM모델과 추론이 가능한 LLM모델과의 차이점에 대해 정리 해보려고 합니다.

Deeplearning AI사와 OpenAI사가 공동으로 마련한 ChatGPT O1강좌의 리뷰입니다.

추론 LLM소개

기존 LLM 모델과 추론이 가능한 LLM 모델의 차이는 보고 들은 것을 흉내내는 어린 아이와 어느 정도 교육을 받은 이후 스스로 생각해 답을 하는 아이와 비교를 들어 설명합니다.

즉 말을 하기 전에 생각을 하는 단계의 LLM 과의 차이 인 것이죠.

기존 LLM은 사용자가 입력한 프롬프트의 내용에 맞추어 가장 확률이 높은 단어들의 조합을 만들어 내는 방식입니다.

생각을 한다라는 것은 이른바 “생각의 사슬(Chain of Thought)”라는 방식을 사용하여 구현 되었다고 합니다.

생각의 고리는 주어진 문제에 대해 고려가 가능한 모든 방식에 대해 검토를 하는 과정을 의미합니다.

따라서 상대적으로 원하는 결과물을 얻기 위해 필요한 프롬프트의 노력이 줄어들 수 있습니다.

생각의 사슬 (Chain of Thought)

예를 들어 설명해 보겠습니다.

사용자가 암호화된 문장 하나와 이 문장의 암호가 해독된 문장을 하나 예를 들어 제시합니다. 그리고 문제를 풀어야 할 암호화 문장을 프롬프트로 입력합니다.

그러면 추론 기능이 추가된 LLM은 암호화된 문장과 원래 문장을 비교하며 여러가지 가설을 세우고 이 가설을 검증하는 작업을 순차적으로 진행합니다.

가정이 맞지 않는 경우 새로운 가정을 생성하고 이에 대한 검증을 순차적으로 진행함으로써 정답에 접근하는 방식이 기존 단순 LLM 방식과 근본적으로 차이가 있는 점입니다.

Completion Tokens

사용자가 프롬프트로 입력한 Token외에, 추론 LLM이 추론 과정에서 발생시킨 toke을 Completion token이라 부릅니다.

- Completion token은 추론 LLM이 생성한 가설에 해당하는 Reasoning token과,

- 이 가설을 검증함으로써 얻게 되는 출력 Token (Output Token) 의 두 가지 종류로 나뉘어 지게 됩니다.

주의해서 이해해야 할 부분은 추론 LLM이 가설들을 검증해 나가는 과정들 중에서 앞서 사용된 Reasoning token들은 다음 번 가설 수립시 입력 prompt로 사용이 되지 않는 다는 점입니다.

아마도 이전 가설의 결과 출력물이 다음 번 가설 수립의 입력에 다시 사용되기 때문에 기존 사용된 가설의 의미는 별도로 입력되지 않아도 다음 번 가설 수립에 그 결과가 참고 되어 다른 가설을 수립하거나 기존 가설을 다 발전 시킬 수 있기 때문데 그럴 것으로 보입니다.

추론 LLM 제작 과정시 발견된 주요 특징

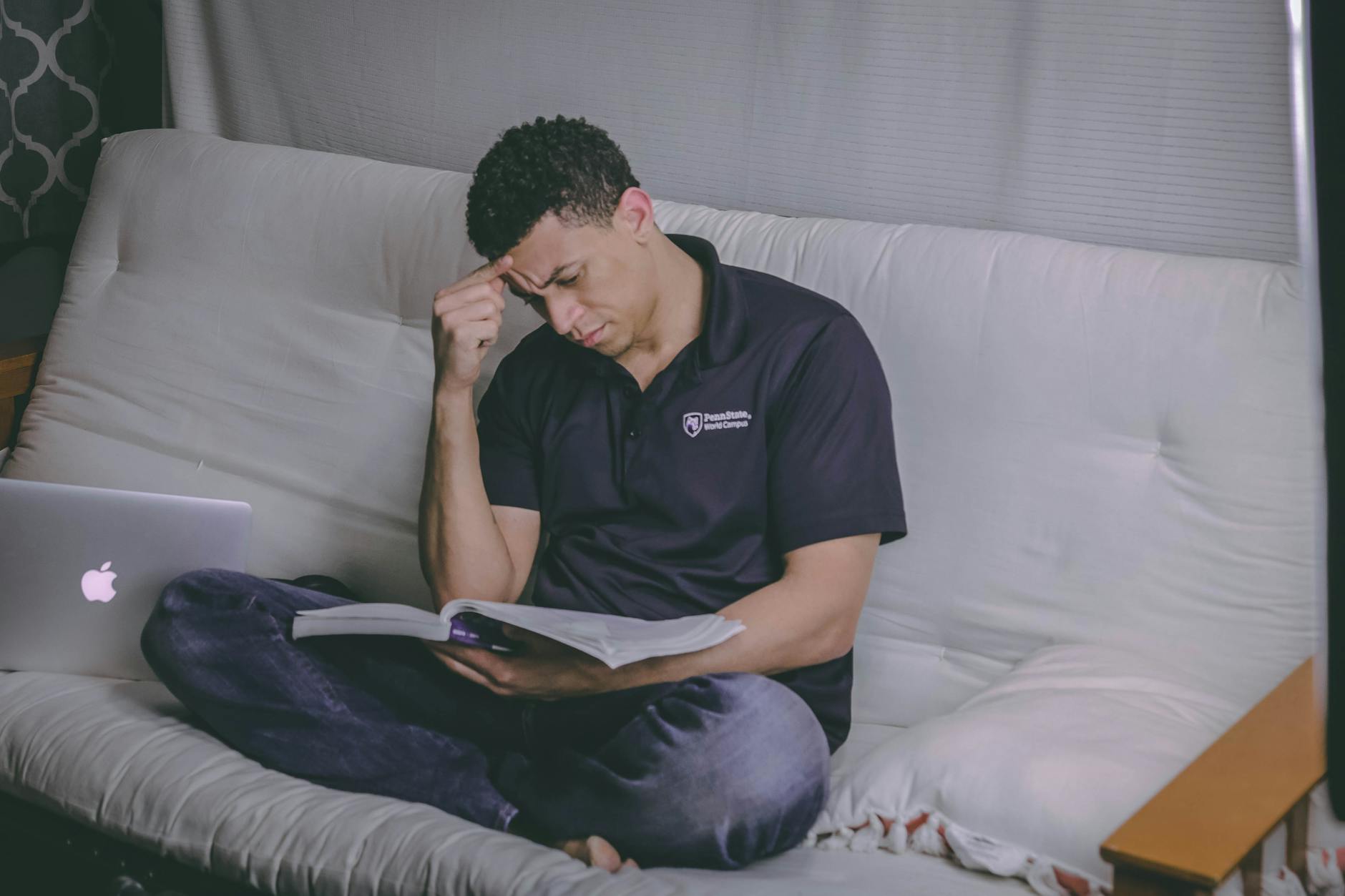

Open AI사의 주장에 따른면 추론 LLM의 training과정에서 re-inforcement 러닝 시간을 증가 할 수록 모델의 출력 정확도가 높아졌다고 합니다.

그러나, 러닝 시간 증가 보다는 추론 LLM의 추론 시간을 길게 하는 것이 위의 방식 보다 훨씬 효과가 있었다고 말하고 있습니다.

마치 아이들을 여러 학원에 오랜 시간 뺑뺑이 돌리는 것 보다 아이들로 하여금 스스로 생각하는 노력에 더 시간을 할애하는 것과 같은 의미이죠.

또 한가지 중요한 점은 가설 검증 결과를 판단할 때, 가설및 결과의 참 거짓 여부를 이른바 “Consensus voting”으로 판단하도록 training했다는 점입니다.

“Consensus voting”은 “합의 투표”정도로 표현할 수 있겠습니다.

일반적으로 모든 참여자가 동의할 수 있는 결정을 찾기 위해 노력하는 방식으로, 단순 다수결보다 더 많은 논의와 협의를 필요로 합니다.

OpenAI O1으로 보는 추론 LLM 동작 과정

- 생각의 고리를 생성합니다.

- 생각의 고리는 대규모의 Reinforcement Learning과정을 통하여 LLM에 트레이닝 시킵니다.

- 이 방식으로 생성된 생각의 사슬은 사용자가 입력한 내용보다 길고 품질이 좋은 정보를 가지게 됩니다.

- 아울러, 생각의 사슬안에는 추가적으로 오류 정정, 여러가지 다양한 전략에 대한 추구 그리고 복잡한 문제를 작은 문제로 분해하는 일을 할 수 있도록 추가적인 정보를 주입합니다.

예상외의 결과 – 추상적인 추론에서도 효과적임이 입증

일반적인 수학, 과학 그리고 컴퓨터 소프트웨어를 만들어 내는 능력보다 더 놀라운 점은 추상적인 내용에 대한 추론도 가능해 졌다는 점입니다.

추상적인 개념을 가지고 있는 명사들. 우리는 문법적으로 추상명사라고 부릅니다.

이러한 추상명사를 무작위적으로 선정하여 각각을 서로 비슷한 개념을 가진 것 끼리 분류하고 이 내용들을 대표하는 추상명사 하나를 선정하라는 작업을 시켰을때 OpenAI O1 추론 LLM 모델은 정확하게 이 작업을 수행한다고 합니다.

아마도 CoT를 통하여 더 많은 “맥락”을 찾도록 훈련되었기 때문에 일반적인 LLM이 줄 수 있는 결과보다 훨씬 의미있는 결과를 줄 수 있지 않나 생각 됩니다.

![A logo representing a calm, happy Sweden countryside village with only blue color palette [and has a minimalist and modern style] [incorporating elements of nature] [with a touch of Scandinavian design] [that reflects a sense of community]](https://raonstad.com/wp-content/uploads/2024/03/img-rsVXmvlyKd0umO7b2rMmaUnI.png)