HBM 반도체

HBM 반도체, 고대역폭 메모리(High Bandwidth Memory, HBM)는 3D 스택 방식의 DRAM을 위한 고성능 RAM 인터페이스입니다.

CPU 또는 GPU와 같은 처리 장치와 연결되어 빠른 데이터 전송을 가능하게 합니다.

고해상도 그래픽, 데이터 센터, 인공 지능, 기계 학습 등의 응용 분야에서는 대량의 데이터 처리와 고속 데이터 전송이 필요합니다.

이에 대한 요구를 충족시키기 위해 HBM이 등장하게 되었습니다.

HBM 반도체 동작원리

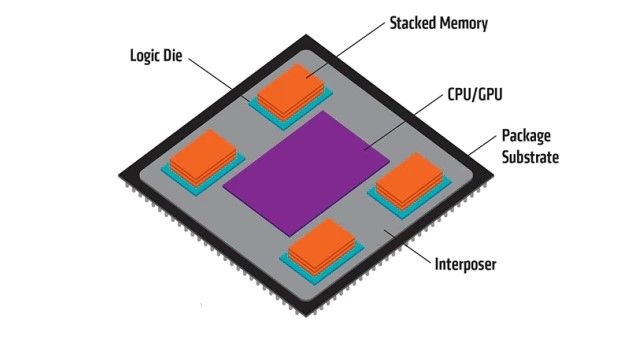

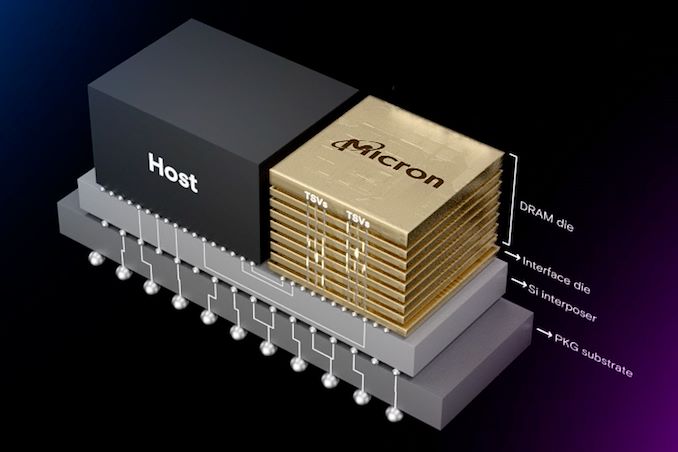

먼저, 메모리 칩들은 적층된 형태로 시스템 보드 상에 배치됩니다. “적층”이라는 말은 마치 우리가 살고 있는 아파트처럼 1층에 메모리가 있고 그 위에 또 메모리가 올라가는 3차원 구조입니다.

한개의 메모리가 32비트의 정보를 전달할 수 있다면 그 위에 8층으로 같은 메모리를 쌓게 되면 전체 메모리가 전달할 수 있는 정보의 양은 256비트가 됩니다. (실제로 HBM3의 경우 규격상 최대 12층의 고층 아파트가 가능합니다!)

그리고, 이런 아파트와 같은 메모리가 4개 동으로 구성되어 지면 한개의 아파트 단지가 한 번에 처리할 수 있는 정보의 양은 1024비트가 됩니다.

이런 식으로 한번에 전달할 수 있는 정보의 양이 많아지면 4번에 나누어 할일을 한번에 끝낼수 있기 때문에 처리 속도가 빨라지게 됩니다.

그러면 어떻게 층층이 겹쳐져 있는 각 메모리에 어떻게 고유의 신호를 전달할 수 있을까요?

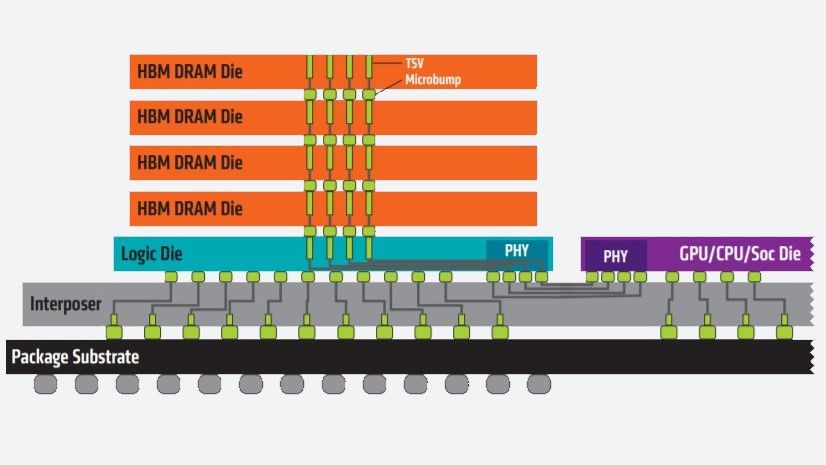

각각의 메모리 칩은 전용 통신 채널을 통해 서로 연결되어 있습니다.

이 연결은 TSV (Through-Silicon Via)라는 기술을 사용하여 이루어집니다.

TSV는 실리콘 칩 안으로 구멍을 뚫고, 그 구멍을 통해 전기 신호와 데이터가 전송되는 길을 만들어 줍니다.

실리콘 칩 내부의 다양한 층들을 연결하고 통신할 수 있게 함으로써 칩의 성능과 효율성을 크게 향상시키는 거지요.

HBM은 TSV 기술을 활용하여 데이터를 수직 방향으로 메모리 층을 통해 전송함으로써 데이터 전송 거리를 최소화하고 대역폭을 크게 확보할 수 있습니다.

HBM 반도체 현재 시장 상황

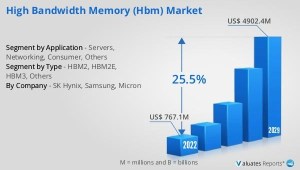

HBM은 JEDEC에 의해 2013년 10월 산업 표준으로 채택되었습니다.

현재까지 HBM1, HBM2, HBM2E 등의 버전이 개발되었으며, 각각의 버전은 대역폭, 용량, 전력 소비 등의 면에서 차이가 있습니다.

HBM을 채용한 최초 장치는 AMD의 피지 GPU입니다.

이후에도 AMD와 엔비디아는 각각의 그래픽 카드에 HBM을 적용하였습니다.

또한 삼성전자와 SK 하이닉스는 HBM 기술을 선도적으로 개발하고 있으며, 다양한 제조업체들과 협력하여 HBM 제품을 공급하고 있습니다.

2022년에는 SK 하이닉스가 HBM 메모리 시장의 50%를 차지했으며, 이어서 삼성이 40%, Micron이 10%를 차지했습니다.

2023년과 2024년 사이에는 삼성과 SK 하이닉스가 시장을 지속적으로 지배할 것으로 예상되며, 두 회사의 지분은 합쳐서 약 95%에 달할 것으로 TrendForce는 예상하고 있습니다.

다음세대 HBM 반도체 규격인 HBM3E 와 HBM4

HBM3E와 HBM4는 HBM기술의 최신 버전입니다.

HBM3E는 2019년에 JEDEC(Joint Electron Device Engineering Council)라는 반도체 표준화 기구에서 표준화되었으며, HBM4는 2021년에 발표되었습니다.

HBM3E와 HBM4의 가장 큰 차이점은 메모리 용량과 대역폭입니다.

HBM3E는 최대 24GB의 용량과 460GB/s의 대역폭을 제공하는 반면, HBM4는 최대 64GB의 용량과 1TB/s의 대역폭을 제공합니다.

이는 HBM4가 HBM3E보다 각각 약 2.7배와 2.2배 높은 성능을 가지고 있다는 것을 의미합니다.

HBM4가 HBM3E 대비 높은 용량과 성능을 낼 수 있는 이유는 더 많은 스택 수(최대 16개)와 더 높은 핀 수(최대 8192개)를 가지고 있기 때문에 가능합니다.

전력 소모와 비용 측면에서도 차이가 있습니다.

HBM3E는 1.2V의 작동 전압을 가지고 있으며, HBM4는 이것을 1V로 낮추었습니다.

이로 인해 HBM4는 HBM3E보다 약 20% 정도 전력 소모를 줄일 수 있게 되었습니다.

그러나, HBM4의 더 많은 스택 수와 더 많은 핀수는 HBM3E 제조보다 더 복잡한 구조와 공정을 요구하기 때문에, 비용 면에서는 더 비쌀수 밖에 없다고 예상됩니다.

향후전망

HBM3E와 HBM4의 향후 전망은 밝습니다.

인공지능(AI)은 현재 IT산업의 핵심 키워드입니다.

마이크로소프트, 메타와 같은 거대 IT기업들은 기업의 사활을 걸고 AI를 활용한 다양한 서비스와 제품을 개발하고 있으며, 이를 위해 AI 연구에 많은 투자를 하고 있습니다.

AI는 빅데이터를 분석하고 학습하는 과정에서 많은 연산력을 필요로 합니다.

또한 경쟁사보다 더 빨리 시장에 제품을 출시하기 위해서는 고성능의 컴퓨팅 장비가 필수적입니다.

이에 따라 NVIDIA와 같은 그래픽 처리 장치(GPU) 제조사와 이런 GPU를 도와 계산 속도를 향상시키는HBM(High Bandwidth Memory) 메모리 반도체의 수요가 필연적입니다.

또한, AI 모델이 점점 거대화 되고 있는 추세입니다.

아울러 중앙 집중적이던 AI모델은 OpenAI사의 GPTs및 GPT store의 등장으로 세분화 및 전문화 되어 가고 있는 추세입니다.

GPU와 HBM의 수요는 앞으로도 계속 증가할 것입니다. 마이크로소프트, 메타와 같은 거대 IT기업의 AI 경쟁이 이를 말해 주고 있습니다.

결과적으로 거대 IT기업들의 AI 생산에 반드시 필요한 NVIDIA의 GPU와 HBM 반도체의 미래는 밝다고 할 수 있습니다.

![A logo representing a calm, happy Sweden countryside village with only blue color palette [and has a minimalist and modern style] [incorporating elements of nature] [with a touch of Scandinavian design] [that reflects a sense of community]](https://raonstad.com/wp-content/uploads/2024/03/img-rsVXmvlyKd0umO7b2rMmaUnI.png)